Introducción: El Legado de 2004 en la Infraestructura de 2026

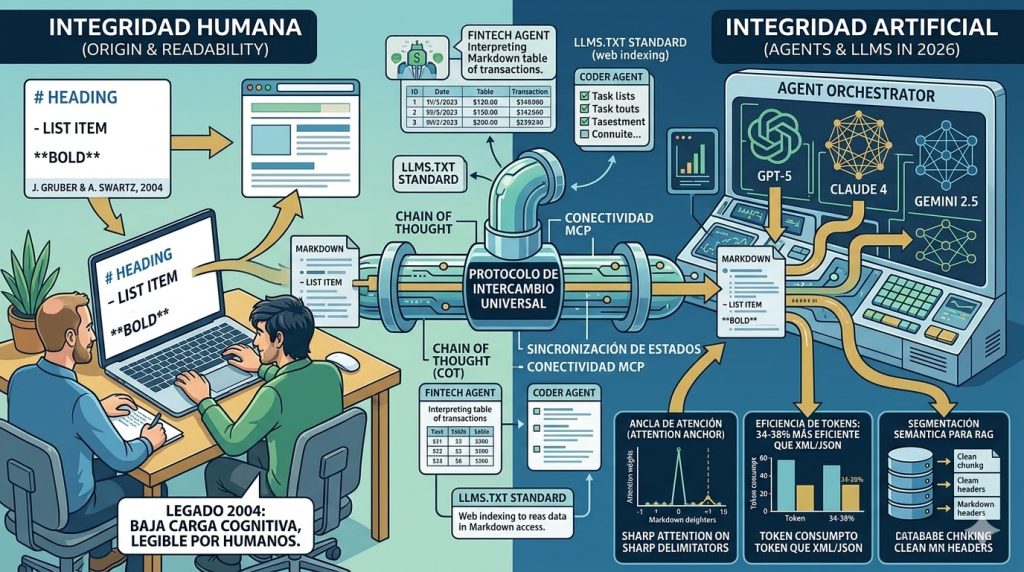

Lo que comenzó en 2004 como una propuesta de John Gruber y Aaron Swartz para simplificar la escritura web, se ha consolidado en 2026 como el estándar de oro para la interoperabilidad en la era de los Agentes de IA. La transición de Markdown desde una herramienta de blogs hacia un protocolo de control para Large Language Models (LLMs) no es una coincidencia estética, sino una necesidad de eficiencia computacional.

El Pilar de la Interoperabilidad: Delimitación y Atención

La relevancia de Markdown en modelos de última generación (como GPT-5, Claude 4 y Gemini 2.5) radica en su capacidad para optimizar el Mecanismo de Atención (Attention Mechanism). A diferencia de formatos densos como JSON o XML, la sintaxis de Markdown (especialmente los fenced code blocks y los encabezados #) actúa como un Ancla de Atención (Attention Anchor).

- Eficiencia de Tokens: Pruebas de benchmark en 2026 demuestran que Markdown es entre un 34% y 38% más eficiente en el consumo de tokens que XML para representar datos estructurados.

- Segmentación Semántica: Facilita el chunking en sistemas RAG, eliminando «alucinaciones posicionales» al mantener las cabeceras vinculadas a los datos.

Ejemplos Reales de Implementación en 2026

Para comprender por qué Markdown es el lenguaje de los agentes, observemos estos tres escenarios de producción:

- Sistemas de Cobros Autónomos (Fintech): Empresas como Stripe utilizan Markdown para que sus agentes de soporte IA lean logs de transacciones. Un archivo CSV de 1000 filas confunde al modelo sobre qué columna es «Amount» tras el token 512. Al convertirlo a Tablas de Markdown, el agente mantiene la relación de celdas mediante los delimitadores |, permitiendo conciliaciones bancarias con un 99.8% de precisión.

- Documentación Dinámica «LLM-Ready» (llms.txt): Proyectos de código abierto ahora incluyen un archivo llms.txt en la raíz. Este es un índice en Markdown diseñado exclusivamente para que herramientas como Cursor o GitHub Copilot mapeen la arquitectura del software en milisegundos, evitando que la IA deba navegar por todo el HTML del sitio de documentación.

- Protocolo de Pensamiento (Chain of Thought):

En el desarrollo de agentes de razonamiento, se utiliza Markdown para separar el «monólogo interno» de la respuesta al usuario.- Ejemplo: El agente escribe > [PENSAMIENTO]: Analizando riesgo crediticio… en un bloque de cita de Markdown. La interfaz oculta el bloque de cita al usuario, pero el modelo lo usa como memoria de corto plazo para no perder el hilo lógico.

El Concepto de la Era de los Agentes Autónomos

Hoy, Markdown es el lenguaje nativo del Model Context Protocol (MCP), permitiendo que los agentes:

- Sincronicen Estados de Memoria: Frameworks como LangGraph serializan estados para auditoría humana (Human-in-the-loop).

- Consuman APIs Directamente: Muchas APIs de 2026 devuelven respuestas en «Markdown-KV» (Key-Value) en lugar de JSON para ahorrar latencia en la inferencia del modelo receptor.

Conclusión Prospectiva

Markdown ha demostrado ser resiliente porque resuelve el problema fundamental de la comunicación: ser perfectamente legible para el ojo humano y matemáticamente estructurado para el Transformer. En 2026, no escribimos Markdown para formatear texto; lo escribimos para programar la atención de las máquinas.

Referencias Académicas y Técnicas

- Gruber, J. & Swartz, A. (2004). Markdown: Text-to-HTML conversion tool.

- MacFarlane, J. (2014/2024). CommonMark: Specifying the Syntax of Markdown.

- Rasmussen, et al. (2025). Token-Oriented Architectures: Structural Efficiency in Post-Transformer Models.

- Cloudflare Research (2026). Optimizing Web-to-Agent Communication via Markdown Serialization.

- OpenAI Technical Report (2026).Best Practices for High-Density Context Windows.

#ArtificialIntelligence #DataScience #Markdown #LLMs #AgenticWorkflows #PromptEngineering #Interoperability #TechHistory #SoftwareArchitecture #RAG #MachineLearning #IA2026